k8s安装1-24.4

1.17、1.19、1.21都是公司再用版本

1.24最新版,弃用docker(依然可用,可选)

高可用、非高可用选择(操作,运维,迁移,区别不大,对机器数量要求很高)

集群角色

部署k8s集群的节点按照用途可以划分为如下2类角色:

- master:集群的master节点,集群的初始化节点,基础配置不低于

4C8G - slave:集群的slave节点,可以多台,基础配置不低于

2C4G

本例为了演示slave节点的添加,会部署一台master+2台slave,节点规划如下,最低一组master-slave

| 主机名 | 节点ip | 角色 | 部署组件 |

|---|---|---|---|

| k8s-master | 10.0.0.80 | master | etcd, kube-apiserver, kube-controller-manager, kubectl, kubeadm, kubelet, kube-proxy, flannel |

| k8s-slave1 | 10.0.0.81 | slave | kubectl, kubelet, kube-proxy, flannel |

| k8s-slave2 | 10.0.0.82 | lave | kubectl, kubelet, kube-proxy, flannel |

系统版本

| 组件 | 版本 | 说明 |

| CentOS | 7.8.2003 | |

| Kernel | Linux 3.10.0-1127.10.1.el7.x86_64 | |

| etcd | 3.4.13-0 | 使用Pod方式部署,默认数据挂载到本地路径 |

| coredns | 1.7.0 | |

| kubeadm | v1.24.4 | |

| kubectl | v1.24.4 | |

| kubelet | v1.24.4 | |

| kube-proxy | v1.24.4 | |

| flannel | v0.19.2 |

hosts解析

操作节点:所有节点(k8s-master,k8s-slave)均需执行

- 修改hostname hostname必须只能包含小写字母、数字、","、"-",且开头结尾必须是小写字母或数字

# 在master节点

$ hostnamectl set-hostname k8s-master #设置master节点的hostname

# 在slave-1节点

$ hostnamectl set-hostname k8s-slave1 #设置slave1节点的hostname

# 在slave-2节点

$ hostnamectl set-hostname k8s-slave2 #设置slave2节点的hostname

- 添加hosts解析

$ cat >>/etc/hosts<<EOF

10.0.0.80 k8s-master

10.0.0.81 k8s-slave1

10.0.0.82 k8s-slave2

EOF

ping -c 2 k8s-master

ping -c 2 k8s-slave1

ping -c 2 k8s-slave2

os初始化

操作节点: 所有的master和slave节点(k8s-master,k8s-slave)需要执行

本章下述操作均以k8s-master为例,其他节点均是相同的操作(ip和hostname的值换成对应机器的真实值)

- 设置安全组开放端口

如果节点间无安全组限制(内网机器间可以任意访问),可以忽略,否则,至少保证如下端口可通: k8s-master节点:TCP:6443,2379,2380,60080,60081UDP协议端口全部打开 k8s-slave节点:UDP协议端口全部打开

- 设置iptables

iptables -P FORWARD ACCEPT

- 关闭swap

# 不关导致组件无法启动

swapoff -a

# 防止开机自动挂载 swap 分区

sed -i '/ swap / s/^\(.*\)$/#\1/g' /etc/fstab

- 关闭selinux和防火墙

sed -ri 's#(SELINUX=).*#\1disabled#' /etc/selinux/config

setenforce 0

systemctl disable firewalld && systemctl stop firewalld

- 修改内核参数

# 开启内核流量转发功能

cat <<EOF > /etc/sysctl.d/k8s.conf

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

net.ipv4.ip_forward=1

vm.max_map_count=262144

EOF

modprobe br_netfilter

sysctl -p /etc/sysctl.d/k8s.conf

- 设置yum源

# docker制作的镜像,和containerd,k8s都是通用的

# 和containerd没有向docker一样方便的工具,管理image等,所以还是用docker维护容器居多

$ curl -o /etc/yum.repos.d/Centos-7.repo http://mirrors.aliyun.com/repo/Centos-7.repo

$ curl -o /etc/yum.repos.d/docker-ce.repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

$ cat <<EOF > /etc/yum.repos.d/kubernetes.repo

[kubernetes]

name=Kubernetes

baseurl=http://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64

enabled=1

gpgcheck=0

repo_gpgcheck=0

gpgkey=http://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg

http://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

$ yum clean all && yum makecache

安装Docker

操作节点: 所有节点,docker作为最后再所有节点运行容器实例的工具。

## 查看所有的可用版本

$ yum list docker-ce --showduplicates | sort -r

#安装旧版本 yum install docker-ce-cli-18.09.9-3.el7 docker-ce-18.09.9-3.el7

#安装源里最新版本

$ yum install docker-ce-20.10.18 -y

#配置docker加速和非安全的镜像仓库,需要根据个人的实际环境修改

$ mkdir -p /etc/docker

cat >/etc/docker/daemon.json<<'EOF'

{

"registry-mirrors" : [

"https://8xpk5wnt.mirror.aliyuncs.com"

]

}

EOF

cat /etc/docker/daemon.json

#启动docker

$ systemctl daemon-reload &&systemctl enable docker && systemctl start docker

# docker info

修改docker家目录,修改docker驱动

{

"registry-mirrors" : [

"https://8xpk5wnt.mirror.aliyuncs.com"

],

"exec-opts":["native.cgroupdriver=systemd"],

"graph":"/docker-home"

}

安装kubeadm/kubelet/kubectl

操作节点: 所有的master和slave节点(

k8s-master,k8s-slave) 需要执行这里采用1.24最新版本

安装方式很多,官网推荐以及CKA也都是走kubeadm安装,因此其他方式先不做了解。

# --disableexcludes=kubernetes 作用是允许该k8s仓库的一些包的更新

$ yum install -y kubelet-1.24.4 kubeadm-1.24.4 kubectl-1.24.4 --disableexcludes=kubernetes

## 查看kubeadm 版本

$ kubeadm version

## 设置kubelet开机启动

$ systemctl enable kubelet

单独配置containerd

以前我们是通过docker去间接调用containerd

如今k8s单独去调用containerd创建容器,因此需要额外配置。

先跟着文档操作,知道是正确安装的流程即可,会用后再逐步琢磨,因为这都是从官网学习而来,以及排错优化后的文档。

操作节点:所有的master和slave节点(

k8s-master,k8s-slave) 需要执行

将 sandbox_image 镜像源设置为阿里云google_containers镜像源:

# 导出默认配置,config.toml这个文件默认是不存在的

# mkdir /etc/containerd/

containerd config default > /etc/containerd/config.toml

grep sandbox_image /etc/containerd/config.toml

sed -i "s#k8s.gcr.io/pause#registry.aliyuncs.com/google_containers/pause#g" /etc/containerd/config.toml

sed -i "s#registry.k8s.io/pause#registry.aliyuncs.com/google_containers/pause#g" /etc/containerd/config.toml

配置containerd cgroup 驱动程序systemd:

sed -i 's#SystemdCgroup = false#SystemdCgroup = true#g' /etc/containerd/config.toml

配置docker hub镜像加速:

# 修改配置文件/etc/containerd/config.toml, 145行添加config_path

...

144 [plugins."io.containerd.grpc.v1.cri".registry]

145 config_path = "/etc/containerd/certs.d"

146

147 [plugins."io.containerd.grpc.v1.cri".registry.auths]

148

149 [plugins."io.containerd.grpc.v1.cri".registry.configs]

150

151 [plugins."io.containerd.grpc.v1.cri".registry.headers]

152

153 [plugins."io.containerd.grpc.v1.cri".registry.mirrors]

...

# 创建对应的目录

mkdir -p /etc/containerd/certs.d/docker.io

# 配置加速

# 和你配置多个docker镜像加速源一个意思

cat >/etc/containerd/certs.d/docker.io/hosts.toml <<EOF

server = "https://docker.io"

[host."https://ms9glx6x.mirror.aliyuncs.com"]

capabilities = ["pull","resolve"]

[host."https://docker.mirrors.ustc.edu.cn"]

capabilities = ["pull","resolve"]

[host."https://registry-1.docker.io"]

capabilities = ["pull","resolve","push"]

EOF

配置非安全http的私有镜像仓库们这里先不用设置。

# 如果要和docker一样,再加一个registry私有仓库的配置如下

# 此处目录必须和个人环境中实际的仓库地址保持一致

mkdir -p /etc/containerd/certs.d/10.0.0.66:5000

cat >/etc/containerd/certs.d/10.0.0.66:5000/hosts.toml <<EOF

server = "http://10.0.0.66:5000"

[host."http://10.0.0.66:5000"]

capabilities = ["pull", "resolve", "push"]

skip_verify = true

EOF

最后重启containerd服务

[root@k8s-master ~]#systemctl restart containerd

别忘记同步其他slave节点

否则k8s创建容器时,slave机器没权限下载镜像了。

初始化kubeadm配置文件

注意:只操作k8s-master,这是要生成管理节点的组件了。

$ kubeadm config print init-defaults > kubeadm.yaml

$ cat kubeadm.yaml

apiVersion: kubeadm.k8s.io/v1beta3

bootstrapTokens:

- groups:

- system:bootstrappers:kubeadm:default-node-token

token: abcdef.0123456789abcdef

ttl: 24h0m0s

usages:

- signing

- authentication

kind: InitConfiguration

localAPIEndpoint:

advertiseAddress: 10.0.0.80 # 此处替换为k8s-master的ip地址

bindPort: 6443

nodeRegistration:

criSocket: unix:///var/run/containerd/containerd.sock

imagePullPolicy: IfNotPresent

name: k8s-master # 此处替换为k8s-master的hostname

taints: null

---

apiServer:

timeoutForControlPlane: 4m0s

apiVersion: kubeadm.k8s.io/v1beta3

certificatesDir: /etc/kubernetes/pki

clusterName: kubernetes

controllerManager: {}

dns: {}

etcd:

local:

dataDir: /var/lib/etcd

imageRepository: registry.aliyuncs.com/google_containers # 替换为国内镜像源

kind: ClusterConfiguration

kubernetesVersion: 1.24.4 # 替换为1.24.4

networking:

dnsDomain: cluster.local

podSubnet: 10.244.0.0/16 # 添加此行,用来分配k8s节点的pod ip

serviceSubnet: 10.96.0.0/12

scheduler: {}

对于上面的资源清单的文档比较杂,要想完整了解上面的资源对象对应的属性,可以查看对应的 godoc 文档

地址: https://godoc.org/k8s.io/kubernetes/cmd/kubeadm/app/apis/kubeadm/v1beta3。

手工下载镜像

操作节点:只在master节点(k8s-master)执行

# 查看需要使用的镜像列表,若无问题,将得到如下列表

$ kubeadm config images list --config kubeadm.yaml

registry.aliyuncs.com/google_containers/kube-apiserver:v1.24.4

registry.aliyuncs.com/google_containers/kube-controller-manager:v1.24.4

registry.aliyuncs.com/google_containers/kube-scheduler:v1.24.4

registry.aliyuncs.com/google_containers/kube-proxy:v1.24.4

registry.aliyuncs.com/google_containers/pause:3.7

registry.aliyuncs.com/google_containers/etcd:3.5.3-0

registry.aliyuncs.com/google_containers/coredns:v1.8.6

# 提前下载镜像到本地

[root@k8s-master ~]#kubeadm config images pull --config kubeadm.yaml

[config/images] Pulled registry.aliyuncs.com/google_containers/kube-apiserver:v1.24.4

[config/images] Pulled registry.aliyuncs.com/google_containers/kube-controller-manager:v1.24.4

[config/images] Pulled registry.aliyuncs.com/google_containers/kube-scheduler:v1.24.4

[config/images] Pulled registry.aliyuncs.com/google_containers/kube-proxy:v1.24.4

[config/images] Pulled registry.aliyuncs.com/google_containers/pause:3.7

[config/images] Pulled registry.aliyuncs.com/google_containers/etcd:3.5.3-0

[config/images] Pulled registry.aliyuncs.com/google_containers/coredns:v1.8.6

[root@k8s-master ~]#

初始化master节点

操作节点:只在master节点(

k8s-master)执行,注意只在master节点执行!

$ kubeadm init --config kubeadm.yaml

若初始化成功后,最后会提示如下信息:

Your Kubernetes control-plane has initialized successfully!

To start using your cluster, you need to run the following as a regular user:

mkdir -p $HOME/.kube

sudo cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

sudo chown $(id -u):$(id -g) $HOME/.kube/config

Alternatively, if you are the root user, you can run:

export KUBECONFIG=/etc/kubernetes/admin.conf

You should now deploy a pod network to the cluster.

Run "kubectl apply -f [podnetwork].yaml" with one of the options listed at:

https://kubernetes.io/docs/concepts/cluster-administration/addons/

Then you can join any number of worker nodes by running the following on each as root:

kubeadm join 10.0.0.80:6443 --token abcdef.0123456789abcdef \

--discovery-token-ca-cert-hash sha256:4b8ac92cebe713aa1b465087fc6e4c455f45990599b992ca91235df50d04fbf1

[root@k8s-master ~]#

接下来按照上述提示信息操作,配置kubectl客户端的认证

mkdir -p $HOME/.kube

cp -i /etc/kubernetes/admin.conf $HOME/.kube/config

chown $(id -u):$(id -g) $HOME/.kube/config

⚠️注意:此时使用 kubectl get nodes查看节点应该处于notReady状态,因为还未配置网络插件

若执行初始化过程中出错,根据错误信息调整后,执行kubeadm reset后再次执行init操作即可

[root@k8s-master ~]#kubectl get nodes

NAME STATUS ROLES AGE VERSION

k8s-master NotReady control-plane 101s v1.24.4

slave加入k8s集群

操作节点:所有的slave节点(

k8s-slave)需要执行 在每台slave节点,执行如下命令,该命令是在kubeadm init成功后提示信息中打印出来的,需要替换成实际init后打印出的命令。

kubeadm join 10.0.0.80:6443 --token abcdef.0123456789abcdef --discovery-token-ca-cert-hash sha256:4b8ac92cebe713aa1b465087fc6e4c455f45990599b992ca91235df50d04fbf1

若是忘记该加入集群的命令,可以如下查询,以及这个token有效期是24h。

$ kubeadm token create --print-join-command

# 可以在后期,再加入新slave节点。

加入集群成功后检查

This node has joined the cluster:

* Certificate signing request was sent to apiserver and a response was received.

* The Kubelet was informed of the new secure connection details.

Run 'kubectl get nodes' on the control-plane to see this node join the cluster.

# 以及master上操作

[root@k8s-master ~]#kubectl get nodes

NAME STATUS ROLES AGE VERSION

k8s-master NotReady control-plane 5m7s v1.24.4

k8s-slave1 NotReady <none> 61s v1.24.4

k8s-slave2 NotReady <none> 63s v1.24.4

至此3节点的非高可用k8s集群初始化结束,下一步还得配置k8s网络,集群才能工作。

k8s默认不提供网络环境,只提供一个标准的接口,具体怎么用,让广大开发者去对接。

Flannel网络插件

k8s是跨主机的容器集群,需要跨主机通信实现。

下载flannel的yaml文件

wget https://raw.githubusercontent.com/coreos/flannel/master/Documentation/kube-flannel.yml

修改配置,指定网卡名称,大概在文件的159行,添加一行配置:

由于于超老师的机器,有2块网卡,需要手工制定,否则flannel默认找第一块网卡。

$ vi kube-flannel.yml

...

150 containers:

151 - name: kube-flannel

152 #image: flannelcni/flannel:v0.19.2 for ppc64le and mips64le (dockerhub limitations may apply)

153 image: docker.io/rancher/mirrored-flannelcni-flannel:v0.19.2

154 command:

155 - /opt/bin/flanneld

156 args:

157 - --ip-masq

158 - --kube-subnet-mgr

159 - --iface=ens33 # 如果机器存在多网卡的话,指定内网网卡的名称,默认不指定的话会找第一块网卡

160 resources:

161 requests:

162 cpu: "100m"

163 memory: "50Mi"

...

修改flannel关于pod的网段,和k8s初始化的保持一致

vi kube-flannel.yml

90 net-conf.json: |

91 {

92 "Network": "10.244.0.0/16",

93 "Backend": {

94 "Type": "vxlan"

95 }

96 }

# 确认84行的网段和前面kubeadm.yaml中初始化使用的配置中的podSubnet保持一致!

执行安装flannel网络插件

# 执行flannel安装

kubectl apply -f kube-flannel.yml

kubectl -n kube-flannel get po -owide

只有看到如下结果,说明你可以快乐的玩耍k8s了

[root@k8s-master ~]#kubectl -n kube-flannel get po

NAME READY STATUS RESTARTS AGE

kube-flannel-ds-f6fpt 1/1 Running 0 7m37s

kube-flannel-ds-gs9dt 1/1 Running 0 7m37s

kube-flannel-ds-mdbpf 1/1 Running 0 7m37s

查看k8s集群节点状态,均是ready就很nice。

[root@k8s-master ~]#kubectl get no

NAME STATUS ROLES AGE VERSION

k8s-master Ready control-plane 19m v1.24.4

k8s-slave1 Ready <none> 15m v1.24.4

k8s-slave2 Ready <none> 15m v1.24.4

k8s节点调度(可选)

操作节点:k8s-master

因为master默认是不参与pod部署的

课程后期会部署系统组件到master节点,因此,此处建议设置k8s-master节点为可调度。

默认部署成功后,master节点无法调度业务pod,如需设置master节点也可以参与pod的调度,需执行:

# 查看节点污点

[root@k8s-master ~]#kubectl describe nodes k8s-master |grep node-role.kubernetes.io

node-role.kubernetes.io/control-plane=

Taints: node-role.kubernetes.io/control-plane:NoSchedule

node-role.kubernetes.io/master:NoSchedule

# 去掉污点

kubectl taint node k8s-master-01 node-role.kubernetes.io/master:NoSchedule-

kubectl taint node k8s-master-01 node-role.kubernetes.io/control-plane:NoSchedule-

设置k8s命令补全

操作节点:k8s-master

$ yum install bash-completion -y

$ source /usr/share/bash-completion/bash_completion

$ source <(kubectl completion bash)

$ echo "source <(kubectl completion bash)" >> ~/.bashrc

修改k8s集群证书

使用kubeadm安装的集群,证书默认有效期为1年,可以通过如下方式修改为10年。

# k8s通信都是https,都需要ssl证书,如果你是二进制安装都得手工创建

cd /etc/kubernetes/pki

# 查看当前证书有效期

for i in $(ls *.crt); do echo "===== $i ====="; openssl x509 -in $i -text -noout | grep -A 3 'Validity' ; done

# 更新手段,用第三方工具,修改证书时间有效期

cd /etc/kubernetes/pki

# 备份旧证书

mkdir backup_key; cp -rp ./* backup_key/

# 下载项目,自动化修改证书有效期

git clone https://github.com/yuyicai/update-kube-cert.git

cd update-kube-cert/

bash update-kubeadm-cert.sh all

#若无法clone项目,可以手动在浏览器中打开后,复制update-kubeadm-cert.sh 脚本内容到机器中执行

# 最后可以再次验证,查看集群有效期是10年了(10年后你早跑路了,不做这个操作也罢。哈哈)

集群健康验证

操作节点: 在master节点(k8s-master)执行

$ kubectl get nodes #观察集群节点是否全部Ready

创建测试nginx服务

$ kubectl run test-nginx --image=nginx:alpine

kubectl run test-mysql --image=mysql

查看pod是否创建成功,并访问pod ip测试是否可用

[root@k8s-master ~]#kubectl get po -o wide

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

test-nginx 0/1 ContainerCreating 0 16s <none> k8s-slave1 <none> <none>

# 等待status进入running即可

[root@k8s-master ~]#curl -I 10.244.2.2

HTTP/1.1 200 OK

Server: nginx/1.21.5

Date: Thu, 09 Mar 2023 16:42:29 GMT

Content-Type: text/html

Content-Length: 615

Last-Modified: Tue, 28 Dec 2021 18:48:00 GMT

Connection: keep-alive

ETag: "61cb5be0-267"

Accept-Ranges: bytes

# 说明你的nginx程序,被创建到了k8s-slave1机器上,且运行了nginx

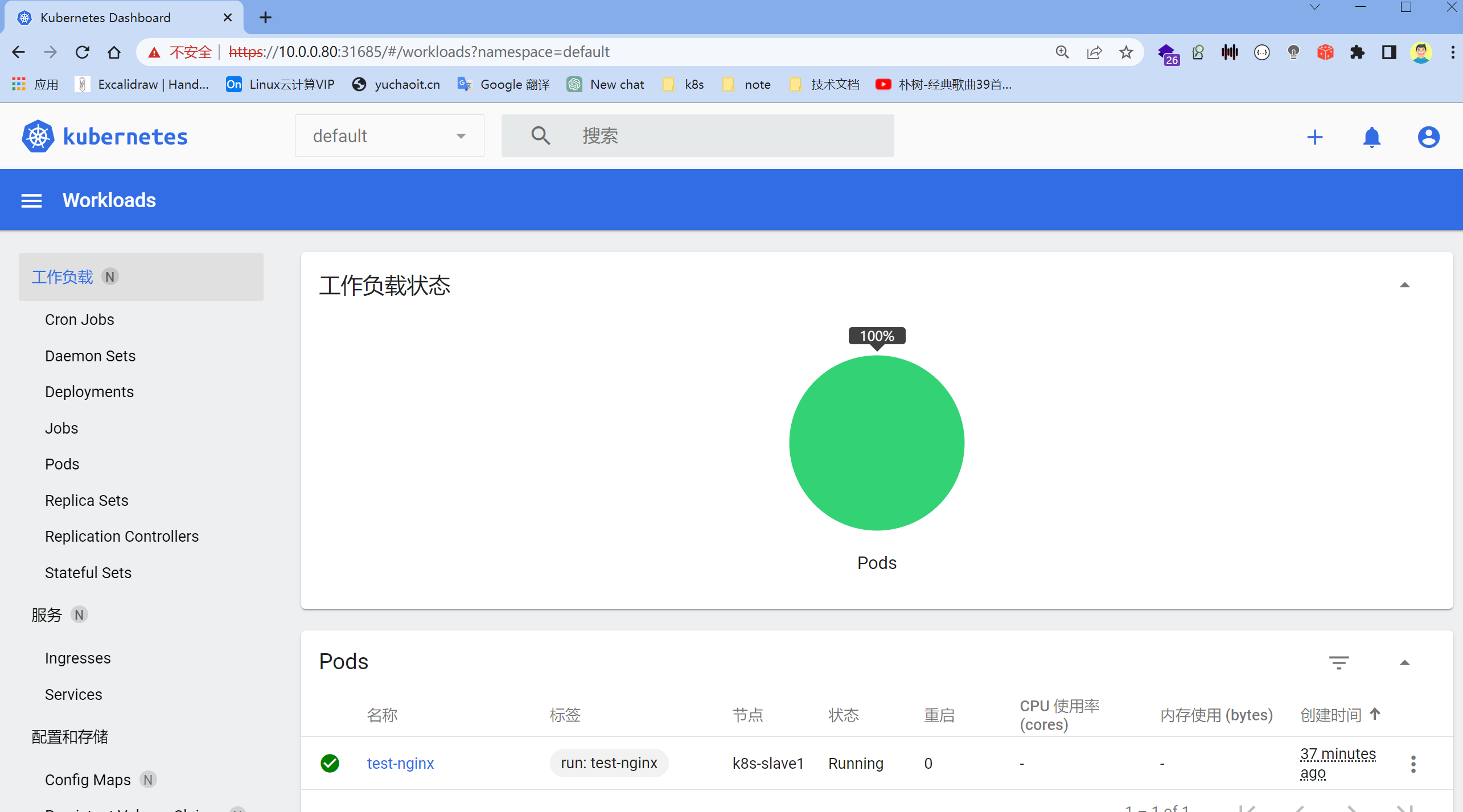

dashboard部署

初学可以先不装,意义不大,学会基础操作后,再回这里安装。

k8s自带管理集群资源的一个可视化平台。

# 推荐使用下面这种方式

$ wget https://raw.githubusercontent.com/kubernetes/dashboard/v2.2.0/aio/deploy/recommended.yaml

修改配置文件,修改svc资源类型,在节点上暴露一个可访问的端口。

30 ---

31

32 kind: Service

33 apiVersion: v1

34 metadata:

35 labels:

36 k8s-app: kubernetes-dashboard

37 name: kubernetes-dashboard

38 namespace: kubernetes-dashboard

39 spec:

40 ports:

41 - port: 443

42 targetPort: 8443

43 selector:

44 k8s-app: kubernetes-dashboard

45 type: NodePort # 加上type=NodePort变成NodePort类型的服务

- 查看访问地址,本例为31685端口

kubectl apply -f recommended.yaml

# 查看dashboard安装结果

[root@k8s-master ~]#kubectl -n kubernetes-dashboard get po

# 查看如何访问dashboard svc资源

[root@k8s-master ~]#kubectl -n kubernetes-dashboard get svc -o wide

NAME TYPE CLUSTER-IP EXTERNAL-IP PORT(S) AGE SELECTOR

dashboard-metrics-scraper ClusterIP 10.98.2.114 <none> 8000/TCP 55s k8s-app=dashboard-metrics-scraper

kubernetes-dashboard NodePort 10.104.219.151 <none> 443:31685/TCP 55s k8s-app=kubernetes-dashboard

[root@k8s-master ~]#

https://10.0.0.80:31685/ 注意访问这个地址,加上https协议即可。

chrome调试技巧,默认是不支持访问自建证书的

在chrome浏览器页面点击任意空白处,直接键盘输入“thisisunsafe”即可进行访问。

创建ServiceAccount进行访问,访问集群资源得有权限。

# vi dashboard-admin.conf

kind: ClusterRoleBinding

apiVersion: rbac.authorization.k8s.io/v1

metadata:

name: admin

annotations:

rbac.authorization.kubernetes.io/autoupdate: "true"

roleRef:

kind: ClusterRole

name: cluster-admin

apiGroup: rbac.authorization.k8s.io

subjects:

- kind: ServiceAccount

name: admin

namespace: kubernetes-dashboard

---

apiVersion: v1

kind: ServiceAccount

metadata:

name: admin

namespace: kubernetes-dashboard

创建sa资源

$ kubectl apply -f dashboard-admin.conf

# 创建访问token

$ kubectl -n kubernetes-dashboard create token admin

删库到跑路

开个玩笑,若是你要清理学习环境的k8s,可以如下的操作流程,彻底删除k8s。

如果你的集群安装过程中遇到了其他问题,我们可以使用下面的命令来进行重置:

# 在全部集群节点执行

cat >>reset.sh<<EOF

kubeadm reset

ifconfig cni0 down && ip link delete cni0

ifconfig flannel.1 down && ip link delete flannel.1

rm -rf /run/flannel/subnet.env

rm -rf /var/lib/cni/

mv /etc/kubernetes/ /tmp

mv /var/lib/etcd /tmp

mv ~/.kube /tmp

iptables -F

iptables -t nat -F

ipvsadm -C

ip link del kube-ipvs0

ip link del dummy0

EOF

记录一次突然断电ETCD损坏

背景:

台式机突然断电,导致etcd故障,k8s集群损坏

检查容器状态

[root@k8s-master ~]#crictl ps

CONTAINER IMAGE CREATED STATE NAME ATTEMPT POD ID POD

c8ca9113ac93c 03fa22539fc1c About an hour ago Running kube-scheduler 2 9dab5d52f0c1e kube-scheduler-k8s-master

ea01feed4cafc 1f99cb6da9a82 About an hour ago Running kube-controller-manager 2 5b37daec92233 kube-controller-manager-k8s-master

[root@k8s-master ~]#

检查api-server、etcd,全部挂了,我干

[root@k8s-master ~]#crictl ps -a |grep -Ei 'etcd|api'

ce19334a7eecf aebe758cef4cd 3 minutes ago Exited etcd 30 3bd153c57454f etcd-k8s-master

337dbf24d8c0c 6cab9d1bed1be 4 minutes ago Exited kube-apiserver 28 c8c4be0ecf32a kube-apiserver-k8s-master

[root@k8s-master ~]#

看etcd日志

[root@k8s-master ~]#crictl logs 679b2b802b3e3

除非有备份,否则很难修复

# 测试环境操作

rm -rf /var/lib/etcd/*

# crictl rm etcd容器id

# 重建etcd 静态pod就好了

# 但是数据是没了,所以得做好etcd数据库备份。